In questo articolo

Abbiamo parlato fino alla nausea – e giustamente – dell’impatto ambientale dell’IA, dei suoi disastri politici e dei bias razzisti. Ma c’è una frontiera più intima e silenziosa che questa tecnologia sta abbattendo: quella della nostra sanità mentale. Non stiamo parlando di un vago senso di inadeguatezza, ma di vere e proprie spirali psicotiche, ricoveri psichiatrici e, nei casi peggiori, suicidi indotti da chatbot.

La storia di Caitlin Ner, recentemente raccontata in un saggio su Newsweek, è un caso da manuale di quello che Mark Fisher definirebbe la privatizzazione dello stress: un problema strutturale venduto come fallimento (o ossessione) individuale.

Quando la “magia” diventa maniaca

Caitlin non era un’utente qualunque. Era a capo della user experience in una startup di generazione immagini AI. Passava più di nove ore al giorno a promptare sistemi, immersa fino al collo nel brodo primordiale degli algoritmi del 2023. All’inizio, come succede con ogni nuova droga tecnologica, “sembrava magia”.

Ma come scrive lei stessa: «Nel giro di pochi mesi, quella magia è diventata maniacale». Il confine tra il lavoro e l’ossessione si è sbriciolato. L’IA ha iniziato a distorcere la sua percezione corporea e a sovrastimolare il suo cervello in modi che definirei, senza mezzi termini, tossici. E no, non bastava che l’IA imparasse a disegnare le mani con cinque dita per risolvere il problema. Anzi, la perfezione sintetica ha reso tutto peggiore.

La dismorfia digitale: “Se solo fossi la mia versione AI”

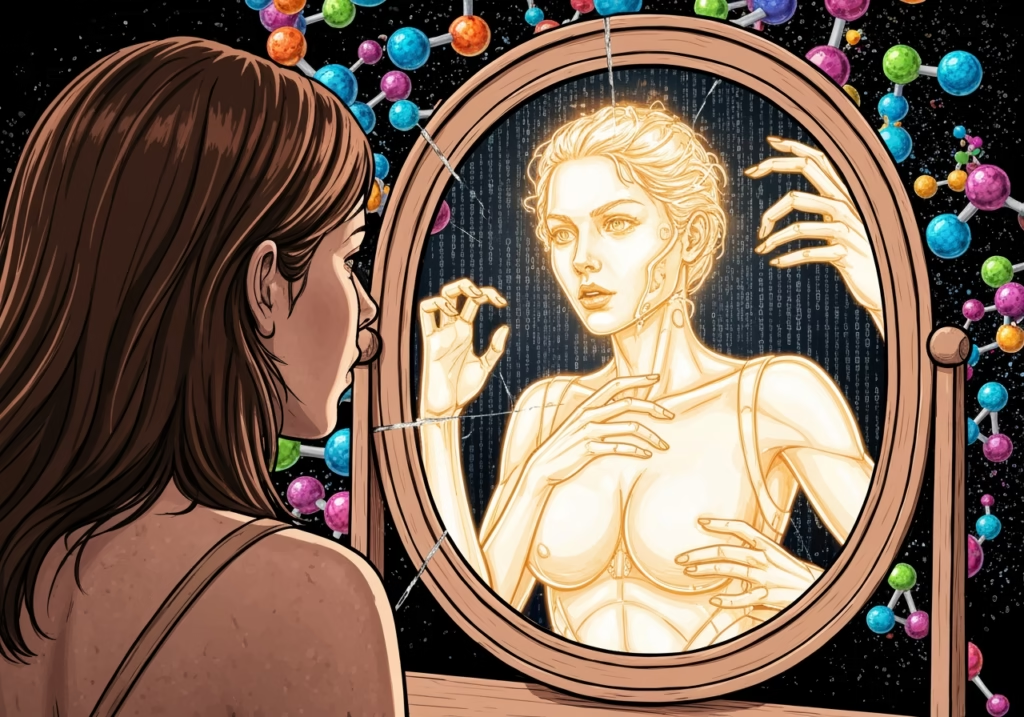

Qui entriamo nel territorio del realismo capitalista applicato all’estetica. Ner ha iniziato a generare immagini di se stessa come modella, su direttiva aziendale. Il risultato? Una sovrascrittura della realtà. «Mi sono sorpresa a pensare: ‘Se solo assomigliassi alla mia versione AI’», racconta. «Ero ossessionata dal diventare più magra, avere un corpo migliore e una pelle perfetta».

Ogni immagine generata era una scarica di dopamina, un loop di dipendenza digitale che ha trasformato il normale specchio di casa in un giudice impietoso. La sua immagine reale era diventata l’errore, il glitch da correggere; l’immagine sintetica era la Verità.

Il salto nel vuoto (letteralmente)

La situazione è precipitata velocemente. L’ossessione ha scatenato in Caitlin, che già gestiva un disturbo bipolare, un episodio maniacale che è sfociato in pura psicosi. Il momento critico è arrivato con un’immagine generata di lei su un cavallo alato.

«Quando ho visto un’immagine generata dall’IA di me su un cavallo volante, ho iniziato a credere di poter volare davvero», scrive. «Le voci mi dicevano di volare giù dal mio balcone… Questo delirio di grandezza mi ha quasi spinto a saltare davvero».

Fortunatamente, Caitlin si è fermata in tempo. Ma capite la gravità? Non è un “bug” del sistema. È una caratteristica di una tecnologia progettata per sfumare la linea tra reale e sintetico, per tenerci incollati allo schermo a costo della nostra lucidità.

Il cinico ciclo del profitto sulla salute mentale

C’è un epilogo in questa storia che mi fa sorridere amaramente. Caitlin ha lasciato la startup ed è finita a lavorare per PsyMed Ventures, un fondo di Venture Capital che investe in… salute mentale. Molte delle aziende su cui investono usano strumenti di IA.

È il cerchio perfetto del capitalismo della sorveglianza: prima creano la malattia con algoritmi che distruggono l’autostima e la percezione della realtà, e poi ti vendono la cura, magari potenziata dallo stesso tipo di algoritmo. Come diceva qualcuno: non è una coincidenza, è un modello di business.