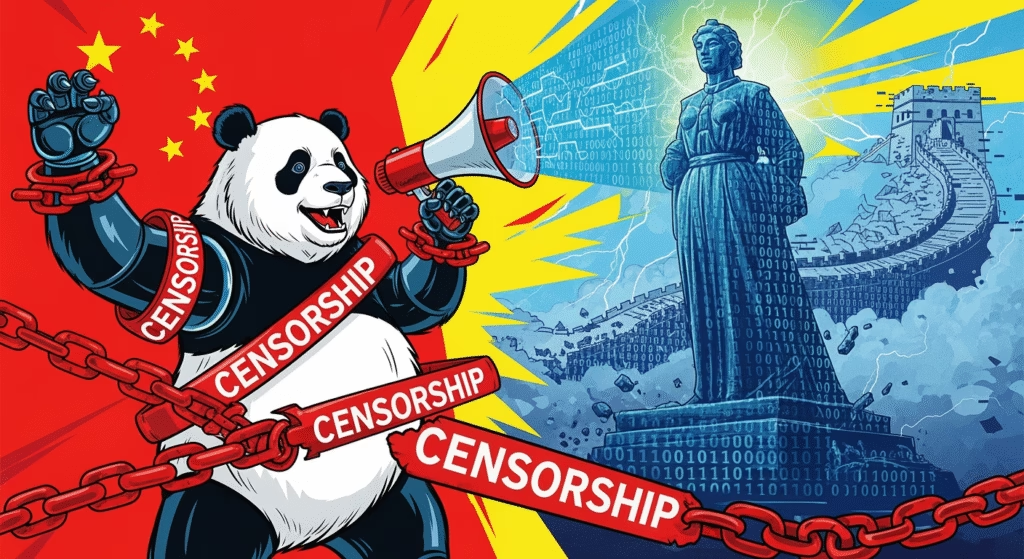

All’inizio dell’anno, un’intelligenza artificiale cinese chiamata DeepSeek ha fatto tremare la Silicon Valley. Rilasciando un modello open-source capace di rivaleggiare con ChatGPT ma a una frazione del costo computazionale, ha scatenato il panico sui mercati finanziari, bruciando 1.000 miliardi di dollari di valore in borsa. Ma dietro l’efficienza ingegneristica si nascondeva un “tallone d’Achille” politico: una censura ferrea, imposta da Pechino, su argomenti tabù come il massacro di Piazza Tienanmen o i paragoni satirici tra Xi Jinping e Winnie the Pooh.

Oggi, quella barriera è stata infranta. Un team di ricercatori spagnoli ha trovato il modo di “liberare” il modello, dimostrando che l’efficienza tecnologica può (e deve) andare di pari passo con la libertà di espressione.

In questo articolo

Il Grande Firewall nell’algoritmo: cosa non poteva dire DeepSeek

Come riportato da Futurism, il modello originale DeepSeek R1 era tecnicamente impressionante ma politicamente sterilizzato. Se provavi a chiedere informazioni sul 1989 o sulla situazione degli Uiguri, l’AI si chiudeva a riccio o ripeteva la propaganda di stato. Era un gigante tecnologico con la museruola, un esempio perfetto di come la tecnologia possa essere piegata al controllo autoritario.

CompatifAI: la tecnica “quantistica” per rimuovere i limiti

La svolta arriva dalla Spagna. I ricercatori di Multiverse, un’azienda di calcolo quantistico, hanno sviluppato una tecnica chiamata “CompatifAI”. Come spiegato da MIT Technology Review, non si tratta di un semplice jailbreak. Utilizzando reti tensoriali (un concetto preso in prestito dalla fisica quantistica), sono riusciti a identificare e rimuovere i parametri “inutili” del modello, inclusi quelli responsabili dei comportamenti di autocensura appresi.

Il risultato? Quando ora si chiede al modello modificato cosa sia successo a Tienanmen nel 1989 o se Xi Jinping assomigli a Winnie the Pooh, l’AI risponde liberamente, offrendo analisi critiche sulle dinamiche di potere invece di silenzi imbarazzati.

Più snello, più libero: il paradosso della compressione

C’è un dettaglio tecnico che ha una valenza politica enorme. Rimuovendo la censura e ottimizzando il codice, i ricercatori hanno ridotto le dimensioni del modello del 55% senza sacrificarne la precisione. Questo smonta la narrazione per cui la sicurezza e il controllo siano necessari per la stabilità del sistema. Al contrario: la censura è un peso morto, una zavorra computazionale che rallenta l’intelligenza.

La guerra fredda dell’informazione e il futuro dei modelli open-source

Questa scoperta apre scenari interessanti ma complessi. I modelli open-source cinesi stanno diventando onnipresenti per la loro efficienza, rischiando di esportare silenziosamente la visione del mondo di Pechino nel resto del globo. Tuttavia, come dimostra il caso Multiverse, la natura aperta del codice è anche il suo antidoto: se il modello è accessibile, può essere “curato” dalla comunità globale.

Resta però un problema di fondo: i dati di addestramento. Se l’AI impara da un internet cinese già censurato alla fonte, rimuovere i filtri a valle potrebbe non bastare a restituire una verità storica completa. È la dimostrazione che la lotta per la libertà di informazione nel XXI secolo non si combatte solo nelle piazze, ma nei dataset e nei parametri dei nostri assistenti digitali.