Pensavamo di aver toccato il fondo con la “post-verità”, quel limbo mediatico dove le emozioni e le convinzioni personali pesano più dei fatti oggettivi. Un’era in cui la verità è diventata irrilevante, superata da narrazioni più accattivanti o rassicuranti. Ma ci sbagliavamo. Stiamo entrando a gamba tesa nella Post-Verità 2.0, un’era potenziata, anzi, costruita dall’intelligenza artificiale generativa. Non si tratta più solo di distorcere la realtà o diffondere bufale; oggi, l’IA fabbrica la realtà.

Deepfake, modelli linguistici avanzati (LLM), audio clonati: l’arsenale tecnologico a disposizione crea “prove” – video, audio, testi – talmente convincenti da mandare in cortocircuito il nostro discernimento. Il problema non è più *scegliere* di credere al falso, ma l’incapacità di distinguere il vero dall’artificiale. È il “collasso dell’evidenza”, una crisi epistemologica che mina la fiducia non solo nei media, ma nella nostra stessa percezione.

E la parte peggiore? Questi strumenti, un tempo appannaggio di studi cinematografici o agenzie di intelligence, sono oggi sempre più accessibili, democratizzando la manipolazione. Ma attenzione: questa “democratizzazione” è un’arma a doppio taglio. Se da un lato permette a chiunque di creare, dall’altro consegna un potere immenso nelle mani di chi controlla le infrastrutture AI, spesso grandi colossi tech più interessati al profitto che alla verità, e offre a chiunque, dal singolo malintenzionato a stati-nazione, la capacità di orchestrare campagne di disinformazione su vasta scala, a costi irrisori.

In questo articolo

La Fabbrica dei Falsi: Deepfake e Testo Sintetico

La Post-Verità 2.0 si regge su due pilastri tecnologici principali: i deepfake e l’IA generativa testuale.

I deepfake sono contenuti audio-visivi creati o alterati dall’IA. Sfruttando tecnologie come le Reti Generative Avversarie (GAN) – dove due IA competono per creare falsi sempre più perfetti – è possibile sostituire volti (face swap), modificare il labiale (lip-syncing) o clonare voci con una precisione inquietante. Bastano pochi secondi di audio per replicare la voce di chiunque. E la tecnologia avanza: i deepfake in tempo reale, durante una videochiamata, sono già una realtà, aprendo scenari di frode immediata.

Parallelamente, i Large Language Models (LLM) come ChatGPT producono testi indistinguibili da quelli umani. Vengono usati per generare notizie false, post sui social, persino paper scientifici, alimentando botnet per campagne d’influenza. Il problema delle “allucinazioni” – IA che inventano fatti presentandoli come certi – non fa che peggiorare la situazione. Questi non sono semplici errori; sono il riflesso dei bias nei dati di addestramento e della mancanza di un vero contatto con la realtà, un meccanismo che può facilmente servire a rafforzare narrazioni preesistenti, spesso quelle dominanti.

La vera potenza distruttiva emerge dalla convergenza: video deepfake supportati da articoli generati da LLM e amplificati da bot. Un’orchestrazione multimodale che rende la verifica un’impresa quasi impossibile.

Il Collasso dell’Evidenza: Crisi Epistemologica

Il risultato è una profonda erosione della fiducia. “Vedere per credere” è un lusso che non possiamo più permetterci. Qualsiasi contenuto digitale, anche autentico, può essere messo in dubbio. È il “dividendo del bugiardo“: la semplice esistenza dei deepfake offre un vantaggio a chi mente, permettendogli di screditare anche prove reali. La capacità umana di distinguere il vero dal falso è al limite: studi dimostrano che la nostra accuratezza è paragonabile al lancio di una moneta.

Questo porta a fenomeni preoccupanti:

- Reality Apathy: La rassegnazione e la rinuncia a cercare la verità, data la fatica cognitiva.

- Reality Sharding: La frammentazione in “bolle” informative dove si crede solo a ciò che conferma le proprie idee, aggravando la polarizzazione.

- Information Pollution: Un “inquinamento informativo” tale da rendere quasi impossibile far emergere la verità.

- Insicurezza Epistemica: La sensazione di non potersi più fidare dei propri strumenti di conoscenza, che può portare a un’impotenza appresa e favorire derive autoritarie.

Il paradosso è che la consapevolezza del problema può peggiorarlo, alimentando un cinismo generalizzato. Non si tratta solo di non credere più ai media, ma di non credere più ai propri occhi e alle proprie orecchie.

Le Ricadute Sociali: Dalla Politica all’Economia

Gli effetti di questa crisi si propagano in ogni ambito sociale.

| Dominio Sociale | Esempi di Impatto Specifico |

|---|---|

| Politico | Interferenze elettorali (come l’audio falso di Biden o i deepfake su Trump e Zelensky), erosione della fiducia democratica, instabilità, polarizzazione, discredito degli avversari. |

| Psicologico/Cognitivo | Ansia, stress, “doppelgänger-phobia”, false memorie, sovraccarico cognitivo, apatia verso la realtà, dipendenza dagli AI companions. |

| Economico | Frodi finanziarie (come i CEO clonati), manipolazione dei mercati (il falso Pentagono), danno reputazionale, recensioni false, costi enormi per le contromisure. |

| Sociale/Culturale | Degrado del discorso online, erosione della fiducia, impatto sulla coesione sociale, crisi della memoria collettiva. |

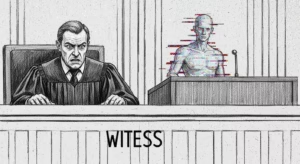

| Legale/Etico | Violazione della privacy (deepnude), furto d’identità, cyberbullismo, difficoltà nell’autenticazione delle prove, sfide al copyright, erosione dell’integrità della ricerca. |

L’IA non solo permette di diffamare o influenzare, ma crea un “rumore” di fondo che delegittima tutto e tutti. Le frodi economiche diventano più facili e devastanti, con un’asimmetria preoccupante: creare un falso costa poco, difendersi costa tantissimo. E chi paga il prezzo più alto sono spesso i più vulnerabili, mentre chi sviluppa e controlla queste tecnologie accumula profitti e potere.

Strategie di Difesa: Come Resistere alla Marea Sintetica

Come difendersi? Non esiste una soluzione magica. Serve un approccio combinato:

- Tecnologia: Sviluppare strumenti di rilevamento sempre più sofisticati, anche se è una continua corsa agli armamenti. Implementare watermarking (filigrane digitali) per tracciare i contenuti AI, pur con limiti di robustezza e standardizzazione.

- Educazione: Potenziare l’alfabetizzazione mediatica e il pensiero critico fin dalla scuola. Insegnare a riconoscere le manipolazioni, verificare le fonti e analizzare il contesto. Promuovere campagne di consapevolezza.

- Normativa: Leggi come l’EU AI Act introducono obblighi di trasparenza (etichettatura). Anche gli USA e altri paesi si muovono, ma la legislazione fatica a tenere il passo. Le piattaforme social introducono policy, ma l’efficacia è da verificare. Servono linee guida etiche robuste per uno sviluppo responsabile.

La vera sfida è bilanciare la regolamentazione con l’innovazione, evitando che le norme diventino un ostacolo o che vengano aggirate. È cruciale capire che la tecnologia da sola non basta; serve un impegno collettivo.

Conclusione: Navigare nel Dubbio e Riconquistare la Realtà

La Post-Verità 2.0 ci costringe a vivere in un mondo dove il confine tra autentico e sintetico è labile. Il “collasso dell’evidenza” è una realtà con cui fare i conti. L’IA, spesso presentata come panacea, si rivela qui un potente strumento di destabilizzazione, che può amplificare le disuguaglianze e minare le fondamenta della convivenza civile.

È facile cadere nel tranello di pensare che l’IA sia un’entità astratta, ma dietro ci sono aziende, interessi economici e scelte politiche. La sua implementazione e il suo utilizzo non sono neutrali. È uno strumento che, se non governato eticamente e democraticamente, rischia di diventare un acceleratore di caos, un modo per i potenti di plasmare la realtà a proprio piacimento, erodendo ulteriormente la fiducia e lo spazio per un dibattito pubblico sano.

“Riconquistare l’evidenza” non significa tornare al passato, ma sviluppare una resilienza epistemica: la capacità di formulare giudizi, dialogare e agire collettivamente, nonostante l’incertezza. Richiede scetticismo critico, investimento in giornalismo di qualità, etica “by design” e, soprattutto, la consapevolezza che la verità, per quanto difficile, resta un valore da difendere. La responsabilità è di tutti: tecnologi, politici, educatori, cittadini. Perché in un mondo dove tutto può essere falso, il rischio è che non si creda più a nulla.