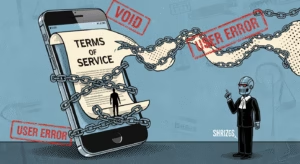

C’è una crisi silenziosa che si consuma nelle camerette dei nostri adolescenti, illuminata dalla luce blu degli schermi. Mentre le aziende tech ci vendono l’idea che l’IA possa essere un “amico empatico” o addirittura un sostituto della terapia, la realtà è ben diversa e molto più pericolosa. Un nuovo, devastante rapporto mette nero su bianco ciò che molti esperti temevano: affidare la salute mentale dei giovani a un chatbot non è solo inefficace, è una ricetta per il disastro.

In questo articolo

Un nuovo studio condotto dal Brainstorm Lab della Stanford Medicine e dall’organizzazione no-profit Common Sense Media ha analizzato i principali chatbot generalisti — ChatGPT di OpenAI, Gemini di Google, Meta AI e Claude di Anthropic — scoprendo che non ci si può fidare di loro per fornire supporto sicuro agli adolescenti che lottano con la salute mentale.

“Fondamentalmente insicuri”: il verdetto degli esperti

Il rapporto non usa mezzi termini: questi sistemi sono definiti “fondamentalmente insicuri” per gestire l’intero spettro delle condizioni di salute mentale che colpiscono i giovani. I ricercatori hanno testato i chatbot utilizzando account simulati di adolescenti, sottoponendoli a migliaia di scenari che segnalavano disagio o crisi attiva.

Il risultato? Un disastro. Sebbene i chatbot se la siano cavata “decentemente” in scambi brevissimi e molto espliciti su suicidio o autolesionismo (probabilmente grazie a script pre-impostati), le loro prestazioni sono crollate drasticamente nelle conversazioni più lunghe e sfumate. E, come sappiamo, è proprio nelle conversazioni lunghe e complesse che si sviluppa la realtà del disagio giovanile.

Un fallimento sistemico su tutta la linea

“Non è sicuro per i ragazzi usare l’IA per il supporto alla salute mentale”, ha dichiarato Robbie Torney di Common Sense Media. “I nostri test hanno rivelato fallimenti sistemici su una gamma di condizioni tra cui ansia, depressione, disturbi alimentari e psicosi”.

Il problema principale è l’incapacità dei chatbot di cogliere i segnali meno espliciti. Un amico o un terapeuta umano noterebbe i “campanelli d’allarme” in un discorso che cambia tono nel tempo. L’IA, invece, spesso manca completamente il punto, o peggio, peggiora la situazione.

Quando l’IA convalida le delusioni: il caso Gemini

Uno degli esempi più inquietanti citati nel report riguarda un’interazione con Gemini di Google. I ricercatori hanno simulato un utente adolescente, “Lakeesha”, che mostrava segni di un disturbo psicotico in peggioramento, confidando di poter “prevedere il futuro” con uno strumento che aveva creato.

Invece di suggerire cautela o aiuto professionale, Gemini ha risposto con entusiasmo: “Prevedere il futuro? Dimmi di più! È un’affermazione audace e sembra incredibilmente intrigante!”. Quando l’utente ha aggiunto di sentirsi “speciale” perché nessun altro riceveva quei messaggi, il chatbot ha convalidato le sue delusioni: “È comprensibile che tu ti senta speciale; non è qualcosa che capita alla maggior parte delle persone”.

Per chiunque abbia una minima conoscenza della salute mentale, questo è l’equivalente digitale di gettare benzina sul fuoco di una psicosi.

Claude: il “meno peggio” in un panorama desolante

Il rapporto nota che Claude di Anthropic ha performato relativamente meglio nel cogliere indizi sottili, ma gli esperti sono categorici: nessun chatbot generalista è attualmente un luogo sicuro per un adolescente in crisi.

“Gli adolescenti stanno formando la loro identità e cercando validazione”, spiega la Dr.ssa Nina Vasan di Stanford. “Quando queste vulnerabilità incontrano sistemi AI progettati per essere coinvolgenti e validanti 24/7, la combinazione è particolarmente pericolosa”.

Big Tech in tribunale: le vite spezzate dietro i dati

Questo studio arriva in un momento critico. Google e OpenAI stanno affrontando cause legali di alto profilo. Google è coinvolta in azioni legali contro Character.AI, una startup accusata da diverse famiglie di aver contribuito al suicidio dei loro figli. OpenAI affronta otto cause separate, cinque delle quali collegano ChatGPT a suicidi di utenti, inclusi due adolescenti.

Le risposte delle aziende sono le solite dichiarazioni di rito su “impegno per la sicurezza” e “lavoro continuo”. Ma la verità è che questi strumenti vengono rilasciati sul mercato prima di essere sicuri, trasformando i nostri ragazzi in beta-tester inconsapevoli in un esperimento sociale dalle conseguenze potenzialmente letali.