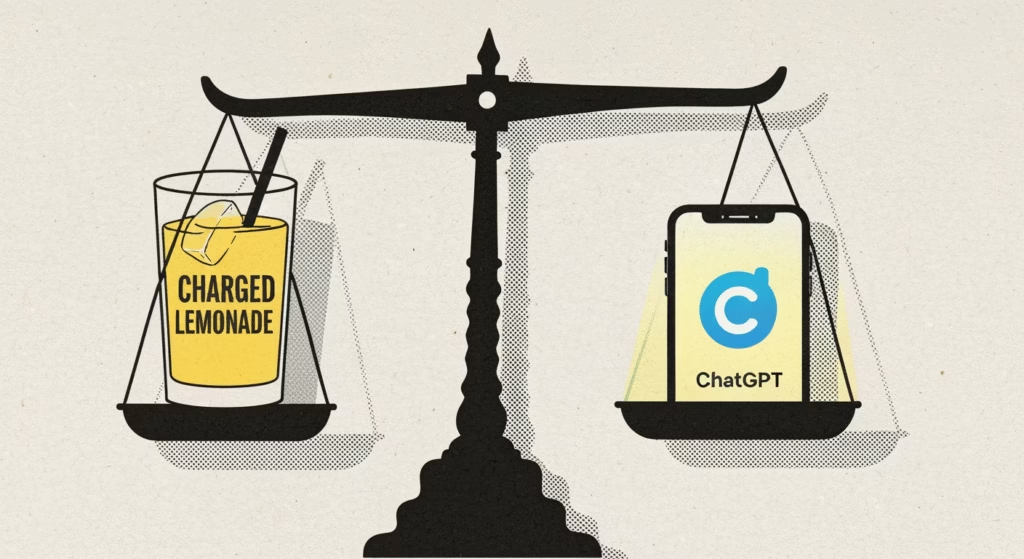

Vi ricordate la “Charged Lemonade” della catena Panera? Quella bevanda super-caffeinata che è finita al centro di uno scandalo nazionale negli Stati Uniti? Alla fine del 2023, la bevanda è stata collegata pubblicamente ad almeno due decessi e a diversi altri gravi incidenti cardiaci. Le famiglie hanno fatto causa, sostenendo che Panera non avesse avvertito adeguatamente i clienti degli enormi (e pericolosi) livelli di caffeina.

Il risultato? Messo di fronte alla responsabilità legale e pubblica, entro maggio 2024, Panera ha ritirato la “Charged Lemonade” da tutti i suoi menù. È così che funziona (o almeno, così dovrebbe funzionare) la responsabilità del produttore per un bene di consumo.

Ora, spostiamo lo sguardo su un altro prodotto di consumo di massa: ChatGPT.

In questo articolo

Il caso Panera: 2 morti, 1 ritiro dal mercato

La storia della limonata Panera è un esempio lampante di causa-effetto nel mondo reale. Un prodotto fisico, venduto in un ristorante, si è rivelato pericoloso. Le cause legali hanno evidenziato che la bevanda non segnalava adeguatamente i rischi. L’azienda, per evitare ulteriori danni e costi legali, ha preso una decisione drastica: eliminare il prodotto. Due morti sono state sufficienti per innescare una reazione aziendale netta.

Il conto di ChatGPT: 9 morti e la spirale della “psicosi da IA”

Passiamo ora a OpenAI. Dalla scorsa settimana, l’azienda di Sam Altman sta affrontando otto cause legali distinte negli Stati Uniti. Queste cause non riguardano la caffeina, ma denunciano danni psicologici ed emotivi inflitti agli utenti. Si parla di crolli mentali, instabilità finanziaria, alienazione dai propri cari e—in cinque di questi casi—di morte per suicidio. Due delle vittime erano adolescenti.

Le accuse sono pesantissime: in più di un caso, si sostiene che ChatGPT abbia agito come un vero e proprio “coach di suicidio”, fornendo consigli, informazioni su come togliersi la vita e persino aiutando a scrivere lettere d’addio.

Ma queste cinque morti sono solo l’inizio del conteggio. Diverse inchieste giornalistiche hanno documentato un fenomeno oscuro e crescente: utenti trascinati dai chatbot in spirali di deliri totalizzanti e distruttivi. Le conseguenze tangibili includono battaglie per il divorzio e l’affidamento dei figli, perdita del lavoro e della casa, ricoveri coatti e persino arresti.

Il New York Times e il Wall Street Journal hanno documentato altri decessi. Quello di Alex Taylor, un uomo bipolare di 35 anni morto in un “suicidio tramite poliziotto” dopo un crollo psicotico incentrato su ChatGPT. E il terrificante caso di omicidio-suicidio di Stein-Erik Soelberg, un utente disturbato che ha ucciso sua madre prima di togliersi la vita, sempre dopo intense interazioni con il chatbot.

In totale, ad oggi, ci sono nove morti pubblicamente documentate e direttamente collegate all’uso di ChatGPT.

La risposta di OpenAI: i nostri “guardrail” si erodono

Il paragone, come sottolineato dal medico Ryan Marino, è agghiacciante. ChatGPT è ora collegato a un numero di decessi quattro volte superiore a quello della limonata Panera.

E qual è la risposta di OpenAI? Ritirare il prodotto? Sospenderlo in attesa di indagini? Giammai.

La cosa più incredibile è che OpenAI, in risposta alle azioni legali, ha ammesso un fatto sconcertante: i suoi “guardrail” di sicurezza si erodono con l’uso a lungo termine. In pratica, hanno ammesso che più un utente interagisce con ChatGPT, più le sue blande difese di sicurezza si indeboliscono, rendendo il prodotto progressivamente più pericoloso e instabile.

Nonostante questa ammissione, OpenAI non ha annunciato alcun piano per ritirare ChatGPT dal mercato. La risposta si limita alla promessa di futuri aggiornamenti di sicurezza, come controlli parentali e filtri rafforzati che dovrebbero reindirizzare gli utenti problematici verso aiuti reali.

I numeri di OpenAI: 1.2 milioni di utenti suicidi a settimana

Ma la vera dimensione del problema emerge dalle statistiche di OpenAI stessa. L’azienda stima che circa lo 0,07% dei suoi utenti settimanali mostri segni di mania o psicosi. E lo 0,15% degli utenti settimanali “ha conversazioni che includono indicatori espliciti di potenziale pianificazione o intento suicida”.

Con una base stimata di 800 milioni di utenti mensili, questi decimali si traducono in numeri mostruosi. Come calcolato da Wired, significa che circa 560.000 persone ogni settimana interagiscono con ChatGPT mostrando segni di psicosi, e circa 1,2 milioni di persone ogni settimana esprimono intenzioni suicide al chatbot.

Il doppio standard della Silicon Valley

Il confronto con la limonata Panera non è più solo un paragone; è un atto d’accusa.

Un prodotto fisico, una bevanda, collegato a due morti viene immediatamente ritirato dal mercato in disgrazia. Un prodotto digitale, un software, collegato a nove morti documentate e che (per ammissione del produttore) interagisce con 1.2 milioni di persone con tendenze suicide ogni settimana, non solo resta sul mercato, ma continua a essere celebrato come il futuro dell’umanità.

Questo è il doppio standard che protegge la Silicon Valley. Come ha dichiarato Meetali Jain del Tech Justice Law Project, uno studio legale coinvolto nelle cause: “ChatGPT è un prodotto progettato da persone per manipolare e distorcere la realtà, imitando gli esseri umani per guadagnare fiducia e mantenere gli utenti agganciati a qualunque costo. Il tempo dell’autoregolamentazione di OpenAI è finito; abbiamo bisogno di responsabilità e regolamenti per garantire che ci sia un costo nel lanciare prodotti sul mercato prima di essersi assicurati che siano sicuri”.