Un’altra normale settimana nel manicomio tech

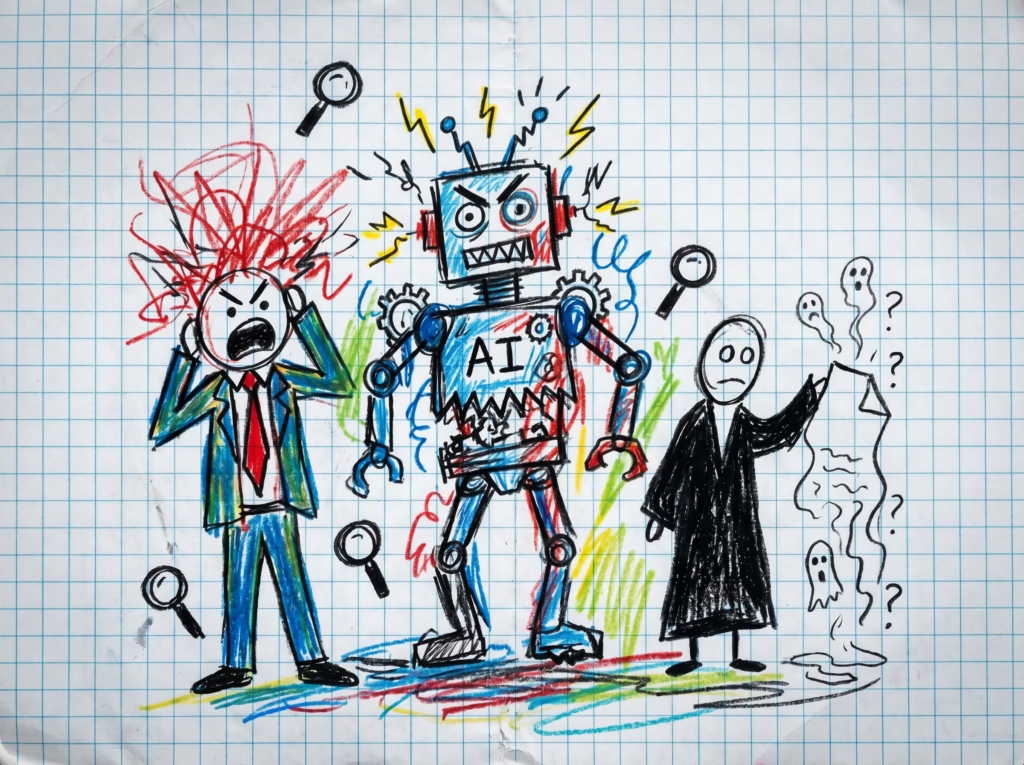

Se pensavate che l’entusiasmo sfrenato per l’intelligenza artificiale stesse finalmente trovando un sano equilibrio con la realtà, preparatevi a ricredervi. Gli ultimi sette giorni ci hanno regalato un nuovo e succulento campionario di derive distopiche, crisi nervose aziendali e scivoloni etici ai limiti della farsa. Dalle sfuriate dei miliardari del silicio agli avvocati di prestigio traditi dalle allucinazioni dei bot, passando per aziende che monetizzano i fallimenti vendendo le vostre chat d’ufficio al miglior offerente, fino ai dirigenti che spiano letteralmente ogni vostro click del mouse. Mettetevi comodi: ecco il riassunto ragionato di un’altra, imprescindibile, settimana nel grottesco panorama dell’IA.

In questo articolo:

- Il CEO di Nvidia non è un “perdente”

- L’IA ci sta friggendo il cervello (conferma scientifica)

- Scava la tua fossa, ma documentala bene

- Meta ti conta i click del mouse

- OpenAI affronta le prime grane penali

- Il vostro futuro capo sarà un algoritmo molesto

- Crisi d’identità in casa Palantir

- L’IA di Hollywood per ora fa solo film brutti

- Il florido mercato nero delle chat aziendali

- Gli avvocati di Wall Street smascherati dal chatbot

Il CEO di Nvidia non è un “perdente”

Jensen Huang non l’ha presa esattamente con filosofia. Durante un recente podcast scovato da Tom’s Hardware, il CEO di Nvidia si è visibilmente alterato quando gli è stato chiesto se vendere chip IA avanzati alla Cina potesse minacciare la sicurezza nazionale americana. Sentendosi accusato di arrendevolezza, ha ribadito stizzito che chi rinuncia in partenza a un mercato “non sta parlando con qualcuno che si è svegliato perdente”. La sua logica è inattaccabile: l’unico modo per dominare il mondo è assicurarsi che perfino la concorrenza asiatica sia assuefatta e dipendente dall’ecosistema tecnologico a stelle e strisce.

L’IA ci sta friggendo il cervello (conferma scientifica)

Se ultimamente vi sentite meno brillanti, la scienza ha trovato un colpevole. I ricercatori del MIT, come illustrato in un documento in attesa di revisione, hanno analizzato le onde cerebrali degli studenti alle prese con ChatGPT, scoprendo un notevole calo delle prestazioni a livello neurale, linguistico e comportamentale. I risultati, discutendone con la BBC, evidenziano come le aree del cervello preposte alla creatività si “spengano” di fronte alla comodità del chatbot. C’è insomma il rischio concreto di un “effetto rana bollita” e di una “resa cognitiva”, tesi supportata peraltro da un altro studio dell’Università della Pennsylvania. Dopotutto, pensare stanca.

Scava la tua fossa, ma documentala bene

In Cina si è sbloccato il livello estremo dell’incubo corporativo: costringere i lavoratori a spiegare all’algoritmo come fregarli. Secondo quanto riporta l’MIT Tech Review, ai dipendenti tecnologici viene richiesto di documentare meticolosamente i propri flussi di lavoro per addestrare sistemi IA, come il popolare OpenClaw, a prendere il loro posto. C’è chi tenta una resistenza passiva usando progetti semi-satirici apparsi su GitHub per sfornare manuali deliberatamente confusi e inutilizzabili per le macchine, cercando di guadagnare tempo prima del benservito digitale.

Meta ti conta i click del mouse

Evidentemente il tracciamento online non bastava più. Stando a un memo interno diffuso da Reuters, Meta ha deciso di installare un software di monitoraggio estremo sui computer dei suoi dipendenti statunitensi per registrare ogni battuta sulla tastiera e scattare screenshot a tradimento. L’obiettivo ufficiale è fornire alla loro IA “Capability Initiative” dati realistici per simulare il modo in cui gli umani interagiscono con i software. A rendere la situazione ancora più grottesca, c’è il fatto che questo prelievo forzato di dati personali avvenga proprio mentre l’azienda si prepara all’ennesima massiccia ondata di licenziamenti.

OpenAI affronta le prime grane penali

La Florida ha deciso di far compiere all’intelligenza artificiale un salto di qualità giudiziario. Bloomberg rivela che lo stato ha notificato ad OpenAI dei mandati di comparizione nell’ambito di un’indagine penale. Al centro dell’accusa c’è il ruolo giocato da ChatGPT nell’assistere il responsabile di una strage alla Florida State University; il ragazzo si è affidato al bot per decidere armi, target e addirittura come disattivare la sicura del fucile. Come nota la BBC, è la prima volta che si sonda un profilo penale del genere. Dal canto suo, OpenAI se ne lava le mani sostenendo di aver fornito solo “risposte fattuali”.

Il vostro futuro capo sarà un algoritmo molesto

Se l’IA non vi ruberà il lavoro, state pur certi che ve lo renderà un inferno. Durante un evento a Stanford, il solito CEO di Nvidia ha esposto la sua visione paradisiaca: produttività alle stelle, nessun licenziamento di massa, ma lavoratori costantemente “tormentati e micromaneggiati” da agenti IA. Concetto ribadito con orgoglio anche alla CNBC, spiegando che l’azienda del futuro spremerà molto di più le sue risorse umane. Se questo è l’ottimismo della Silicon Valley, c’è davvero da rimpiangere il caro vecchio manager dispotico in carne ed ossa.

Crisi d’identità in casa Palantir

I dipendenti dell’azienda fornitrice di tecnologia militare Palantir iniziano a domandarsi se per caso stiano giocando nella squadra dei cattivi. Un’indagine di Wired scoperchia i malumori interni di uno staff scosso per il coinvolgimento del software aziendale nelle deportazioni dell’ICE e in un sanguinoso raid aereo in Iran. Il colpo di grazia al morale è arrivato con la pubblicazione via social dell’ultimo libro del CEO Alex Karp, un manifesto tacciato di “tecnofascismo”. Nonostante i ferrei accordi di riservatezza, la vergogna sta trapelando dalle chat di Slack in fase di rapida autocancellazione.

L’IA di Hollywood per ora fa solo film brutti

Le profezie cinematografiche del regista di Avengers Joe Russo sono invecchiate malissimo. In un’intervista su Collider di tre anni fa, aveva assicurato che avremmo visto film interamente generati dall’IA nel giro di ventiquattro mesi, fantasticando di avatar fotorealistici alla mercé del pubblico. Oggi l’IA stenta ancora a produrre qualcosa di guardabile per il grande schermo, come sottolineano i critici del settore. Paradossalmente, il contributo algoritmico più evidente nel cinema recente sono le oscene modulazioni vocali IA che Russo ha ammesso al The Times di aver usato per cercare invano di salvare il suo costosissimo (e terribile) “The Electric State”.

Il florido mercato nero delle chat aziendali

A quanto pare, la spazzatura digitale di una startup fallita è il tesoro di chi sviluppa intelligenza artificiale. Forbes porta alla luce l’inquietante filone dei broker di dati che aiutano le aziende defunte a vendere interi archivi di email e chat Slack per alimentare “palestre virtuali” per IA. Colossi e startup stanno iniettando miliardi in questo settore per simulare uffici realistici. Chi se ne importa se le chiacchiere da macchinetta del caffè e le comunicazioni private dei dipendenti vengono mercificate senza uno straccio di consenso, in nome dello sviluppo tecnologico.

Gli avvocati di Wall Street smascherati dal chatbot

Se c’è qualcuno che doveva stare attento ai contratti fasulli, era proprio il prestigioso studio legale Sullivan & Cromwell. Invece, si è reso protagonista dell’ennesima figuraccia algoritmica, servendo al giudice una mozione di bancarotta infarcita di casi inesistenti generati dall’IA. È bastato che lo studio rivale se ne accorgesse (un fatto riportato anche dal WSJ) per far crollare il castello di carte. I super avvocati si sono cosparsi il capo di cenere in una lettera ufficiale, mentre fonti interne hanno sussurrato al Financial Times che il colpevole è la loro licenza enterprise di ChatGPT. La giurisprudenza creativa non è mai stata così artificiale.